문화적 차원, 연령과 언어가 AI에 대한 신뢰, 수용성, 의존도에 미치는 영향에 관하여

문화적 차원, 연령과 언어가 AI에 대한 신뢰, 수용성, 의존도에 미치는 영향에 관하여

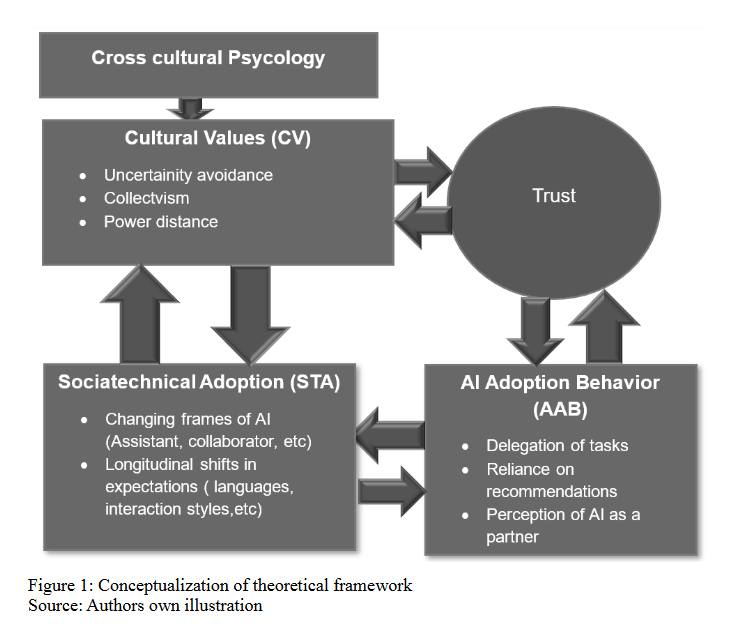

본 연구는 인공지능(AI) 기술이 일상과 전문 환경에 빠르게 확산되는 가운데, 기술적 측면이나 윤리적 위험성에만 초점을 맞춘 기존 연구의 한계를 지적합니다.

1. 연구의 목적

- AI가 서로 다른 문화권에서 어떻게 수용되고 있는지, 그리고 이러한 수용 패턴이 인간의 일상적인 삶의 전략(특히 인지 전략)을 어떻게 변화시키는지를 실증적으로 탐구합니다.

- 9개 국가(유럽, 아프리카, 아시아, 남아메리카 포함) 대상, 문화적·인구통계학적 변수가 AI에 대한 신뢰, 윤리적 수용성, 의존도에 미치는 영향을 규명합니다.

2. 연구의 방법

- 9개국 21명을 대상으로 상호문화 심리학, 디지털 윤리, 사회기술시스템 이론에 기반한 정량적 파일럿 설문을 진행했습니다.

- 표본의 다양성을 확보하고, 기술통계, 교차분석, 그리고 ‘연령’과 ‘AI의 교육적 활용’ 간의 관계를 분석하기 위해 카이제곱 검정으로 분석했습니다.

3. 주요 발견

- 문화가 AI 사용에 영향을 미치며(81%), 특히 ‘연령’(95.2%)과 ‘언어’(71.4%)가 핵심 요인으로 나타났습니다.

- 주목할 점은, 30세 이상의 성인 참가자들이 30세 미만 참가자들보다 AI를 교육적 목적으로 더 많이 활용한다고 보고했다는 것입니다.

- AI 윤리는 상황적 윤리, 즉 맥락에 따라 달라집니다. 전문적 맥락(직장)에서는 협력자(57.1% “OK”)로, 학술적 맥락(교육)에서는 부정행위(66.7% “Cheating”)로 인식되었습니다.

- AI 신뢰는 보통(4.1점/8점) 수준이었으나, 데이터 안전성에 대한 우려(5.9점/8점)는 높았습니다.

4. 결론 및 시사점

- AI 수용은 보편적이거나 가치 중립적이지 않으며, 문화와 특정 영역, 윤리적 상황에 따라 조건화됩니다.

- 직장에서의 실용성과 교육에서의 표절 우려 간의 극명한 인식 차이는 유연하고 분야별 특수성을 반영한 AI 거버넌스를 요구합니다.

- 비판적 감독 없는 AI의 일상화는 윤리적 안일함에 빠질 위험이 있습니다.

5. 리뷰어의 ADD(+) One: 생각 더하기

- (강점) 상황적 윤리(직장 OK vs 교육 Cheating)를 실증하고, 30대 이상이 AI를 교육 목적으로 더 사용한다는 디지털 네이티브 편견을 타파했습니다.

- (제언) 학생과 교원을 위한 이원적 AI 정책과 맥락 기반 AI 윤리 교육이 세심하게 고려되어야 합니다.

- (제언) 언어(71.4%)가 AI 활용의 핵심 변수이므로 AI가 비원어민 학생들의 언어 장벽을 증폭(AI의 언어 편향성) 시키는지, 혹은 효과적인 보조 도구가 되는지 면밀히 관찰하고 관련 리터러시 교육을 제공해야 합니다.

6. 추가 탐구 질문

- AI 활용도가 높은 30세 이상 그룹이 명확히 구분되지 않는데, 교원일까 아니면 고연령 학생일까?

- 데이터 불안감(5.9점/8점)의 실체는 무엇이며, 불확실성 회피(Uncertainty Avoidance)와 같은 특정 문화 차원이 AI 신뢰도와 어떻게 연결될까?

- 인지적 짐 덜기(cognitive offloading)은 문화에 따라 어떻게 다르게 해석될까? 본 연구처럼, 실용적인 전문적 맥락에서는 ‘효율성’으로, 엄격한 학술 맥락에서는 ‘게으름’이나 ‘부정행위’ 로 모든 문화에서 인식될까? 아니면 그렇지 않을까?

_출처: Cummings-Koether, M. J., Durner, F., Shyiramunda, T., & Huemmer, M. (2025). Cultural Dimensions of Artificial Intelligence Adoption: Empirical Insights for Wave 1 from a Multinational Longitudinal Pilot Study. arXiv. https://arxiv.org/abs/2510.19743v1